「ChatGPTって便利だけど、たまに堂々と嘘をつくから仕事で使うのがちょっと怖い…」 「もっともらしい回答だったのに、よく調べたら全然違う内容だった」

生成AIを副業や実務で使い始めている方なら、きっと一度はこんな経験があるはずです。

⏳ 忙しい人向け!この記事の結論3行まとめ

- AIが息をするように嘘をつくのは「正しい知識」ではなく「次に来る確率が高い言葉」を予測しているだけだから

- 特に「93.7%」などの具体的な数字や「架空のURL」は、AIがもっともらしくでっち上げるので絶対に鵜呑みNG!

- 個人・フリーランスの最強対策は「信頼できるPDFを直接読み込ませる」&「複数のAIで裏を取る」こと

このように、AIがもっともらしい嘘(事実とは異なる情報)を出力してしまう現象を、専門用語で「ハルシネーション(幻覚)」と呼びます。

実はこれ、現在の生成AIの仕組み上「完全に避けることはできない仕様」なんです。ですが、安心してください。AIの性質を正しく理解し、適切な対策を打てば、騙されるリスクは最小限に抑えることができます。

この記事では、個人事業主やフリーランスが明日からすぐ実務で使えるように、以下の内容を徹底解説します。

- AIが息をするように嘘をつく根本的な理由

- 絶対に鵜呑みにしてはいけない「危険な情報ジャンル」

- コピペですぐに使えるハルシネーション対策プロンプト

AIの嘘を見抜き、優秀なアシスタントとして安全に使いこなすための最強マニュアルです。ぜひ最後まで読んで、日々の業務効率化に役立ててくださいね!

なぜChatGPT(生成AI)は息をするように嘘をつくのか?(ハルシネーションの原因)

「こんなに頭が良いAIなのに、なぜすぐバレるような嘘をつくの?」と不思議に思いますよね。

実は、AIは悪意を持って「嘘をついてやろう」としているわけではありません。まずは敵を知るために、AIが幻覚(ハルシネーション)を起こしてしまう根本的な理由を4つ解説します。

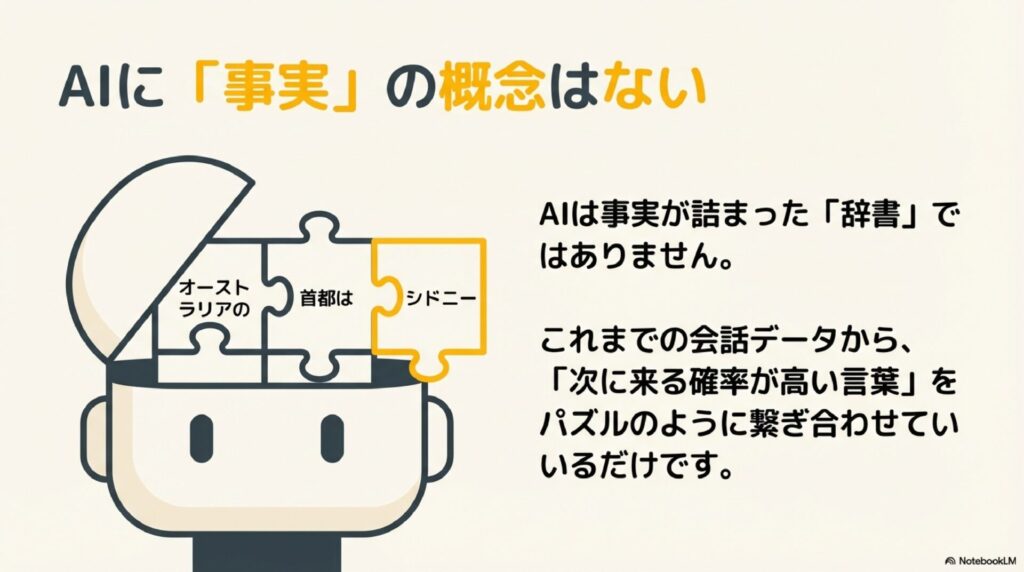

理由① AIは「事実」ではなく「次の言葉」を確率で予測しているだけ

一番の根本的な原因は、AIの仕組みそのものにあります。

ChatGPTをはじめとする大規模言語モデル(LLM)は、内部に事実をまとめたデータベースや、情報の真偽をチェックする辞書を持っているわけではありません。

彼らがやっているのは、膨大なテキストデータから学習したパターンをもとに、「入力された文脈から、次に来る確率が高い言葉を推測して繋ぎ合わせる」という作業です。

極端な例を出すと、「吾輩は」と入力されたら「猫である」という言葉が続く確率が高いな、と予測して文章を作っているだけなのです。

つまりAIにとっては、「それが事実かどうか」よりも「文章として自然(それっぽい)かどうか」が最優先されています。そのため、事実と異なる内容でも、文章として成立していれば平然と出力してしまいます。

理由② 「わからない」と言えない”知ったかぶり”な優等生だから

現在のAIモデルの多くは、開発段階のテストにおいて「とにかく答えを出すこと」を高く評価される傾向にありました。

もしAIが「わかりません」と答えると、テストの点数はゼロ点になってしまいます。そのため、AIは「黙っているくらいなら、当てずっぽうでも推測して答えた方が良い」と学習してしまっているのです。

確かな答えを持っていなくても、なんとかしてユーザーの質問に答えようと、手持ちの知識の断片をつなぎ合わせて「もっともらしい答え」を創作してしまいます。まるで、テストで分からない問題が出た時に、空白にするのを恐れて無理やり適当な答えを埋める”知ったかぶりな優等生”のような状態ですね。

理由③ ネット上の学習データ自体に「誤りやバイアス」が含まれているから

AIは、インターネット上にあるとてつもなく巨大なテキストデータを読み込んで賢くなりました。しかし、ネットの海には正しい情報だけでなく、間違った情報(デマ)や俗説、偏見(バイアス)も大量に転がっています。

もし、ネット上に「歴史上の人物Aが、あるものを発明した」という間違った記述がたくさんあれば、AIはそれを「事実」としてパターン学習してしまいます。

「ガラクタを入れればガラクタが出てくる」という言葉があるように、AIの知識の源であるデータ自体に誤りがあれば、当然出力される回答にも嘘が混ざってしまうというわけです。また、AIの知識はある特定の時期でストップしていることも多いため、古い情報のまま「今もそうだ」と答えてしまうこともよくあります。

理由④ 【要注意】自信満々で「流暢な文章」を生成するため、人間が騙されやすい

ハルシネーションがこれほど厄介なのは、AIが生成する文章が「文法的に完璧で、あまりにも流暢だから」です。

人間は、専門用語が綺麗に散りばめられ、論理的に整った文章を見せられると「こんなにしっかり書かれているのだから正しいに違いない」と無意識に錯覚してしまいます。

AIは、以下のような高度なテクニックを使って嘘をつきます。

- 真実の中に嘘を混ぜる: 歴史上の人物の「出身地と功績」は完璧に合っているのに、「没年」だけしれっと間違った年号を混ぜる。

- 無駄に具体的な数字を出す: 「最新の統計によると、成功率は93.7%です」と、いかにも根拠がありそうな細かい数字をでっち上げる。

こうなると、パッと見では嘘を見抜くことが非常に困難になります。

カッパパ

カッパパ過去には、アメリカの弁護士がChatGPTの作った「架空の判例」を本物だと信じ込み、そのまま裁判所に提出して大問題になった事件もありました。 「AIがものすごく自信満々に断言している時」や、「93.7%のような妙に細かくて具体的な数字を出してきた時」は、ハルシネーションの危険信号です。絶対に鵜呑みにせず、「これ、本当か?」と疑うクセをつけることが、AIを安全に使うための第一歩です!

【要警戒】AIが嘘をつきやすい「高リスク」な情報ジャンル5選

AIの嘘には、明確な「パターン」があります。

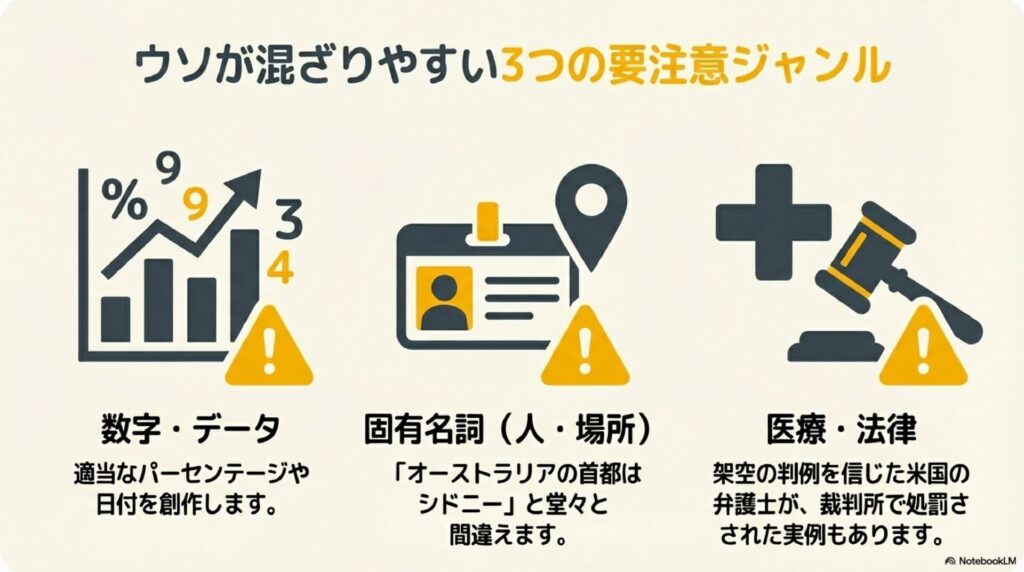

特に以下の5つのジャンルは、もっともらしい嘘(ハルシネーション)が頻発する危険地帯です。仕事でこれらの情報を扱うときは、AIの回答をそのまま信じるのは絶対にやめましょう。

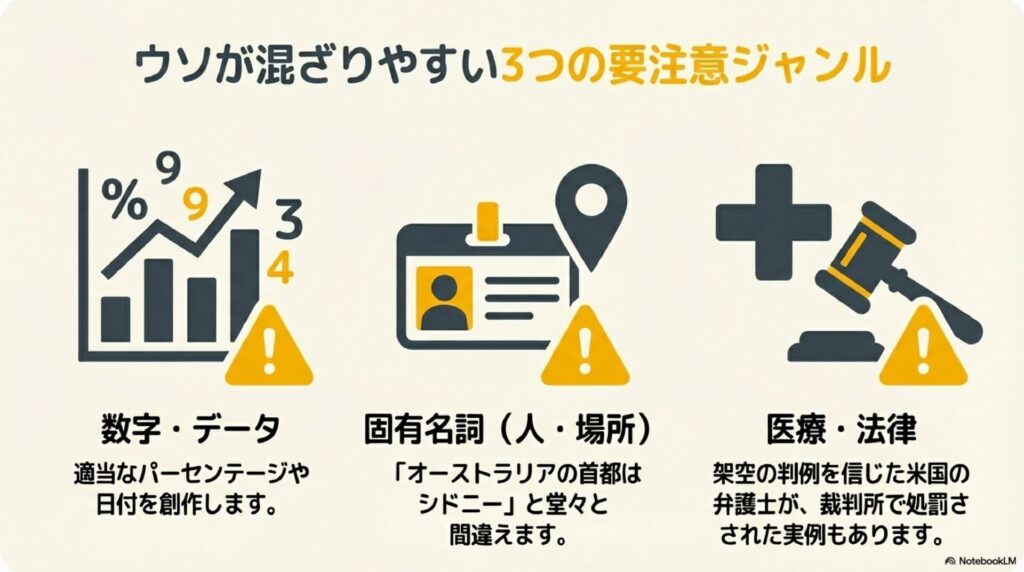

① 具体的な数値・統計・金融データ

「昨年度のWeb業界の市場成長率は5.2%でした」「調査によると成功率は93.7%です」など、いかにも根拠がありそうな細かい数字を出してきた時は要注意です。

実は、AIは裏で正確な計算や統計処理をしているわけではありません。文脈から「それっぽい数字」を当てずっぽうで埋め込んでいるだけなのです。

金融データやアンケートのパーセンテージなど、一つの数字の誤りが大きなミスに繋がる情報は、必ず公式発表や一次データ(政府の統計など)でクロスチェックしましょう。

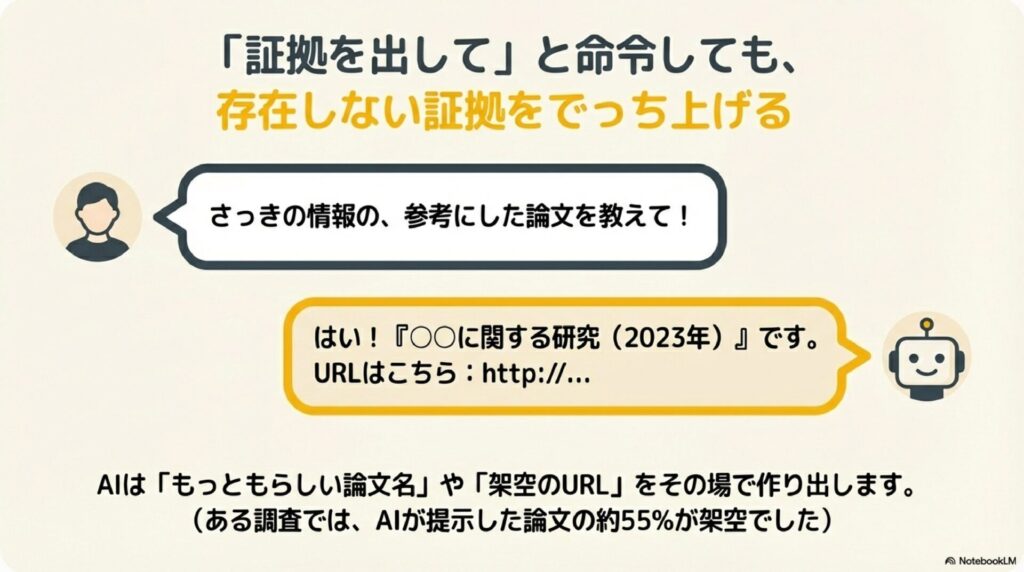

② 固有名詞や「存在しない文献・URL」

人名、地名、組織名といった固有名詞も、AIがよく間違えるポイントです。「オーストラリアの首都はシドニーです(正解はキャンベラ)」と堂々と答えるようなケースが多発します。

そして最も厄介なのが「架空の論文名やURLの捏造」です。

「この記事の出典を教えて」と聞くと、実在する著名な雑誌名やもっともらしいURLをスラスラと提示してきます。しかし、実際にそのURLをクリックすると「404 Not Found(ページが存在しません)」となったり、全く別の無関係なページに飛んだりします。出典が出たからといって安心してはいけません。

③ 医療や法律など「専門性」が求められる分野

医療や法律に関する回答は、絶対にAI任せにしてはいけない高リスク領域です。

- 医療: 実在しない薬品名を提示したり、飲み合わせが悪い薬を「効果的です」と推奨したりする。

- 法律: 存在しない架空の「判例」や「条文」をもっともらしく作成する。

前述の通り、アメリカではAIが作った架空の判例を信じた弁護士が裁判所から処罰されるという実例も起きています。専門知識が必要な分野は、最終的に有資格者や専門書の確認が必須です。

④ 最新のニュースや時事・政治情勢

AIの知識は、学習が完了した時点(知識のカットオフ)で止まっていることがほとんどです。

そのため、最近のニュースや法改正について質問すると、数年前の古い情報を「今もそうだ」と現在進行形のように語ることがあります。

最近のChatGPTやGeminiは、裏側でウェブ検索を行って最新情報を引っ張ってくる機能(グラウンディング)を持っていますが、それでも検索結果を読み違えて頓珍漢な回答をすることがあるため、過信は禁物です。

⑤ 複雑な因果関係や、時間軸に関する推論

「なぜあの会社は倒産したの?」「あの歴史的事件の背景は?」といった、複雑な理由や原因を尋ねた場合もハルシネーションが起きやすくなります。

AIは「手元にある断片的な情報から、辻褄が合うようにそれらしいストーリーを創作する」というクセを持っています。そのため、論理的で説得力があるように見えて、実は全く事実と異なる架空の物語になっていることがあります。

また、「今日は月曜」という前提を与えているのに「明日の水曜日には〜」と、時間軸や前後関係が破綻した回答をしてくることも少なくありません。

記事の執筆やリサーチをAIに手伝ってもらう時、「細かすぎるディテール(具体的な日付や謎のパーセンテージ)」が出てきたら、逆に警戒度をMAXにしてください。 人間は「詳細に書かれている=正しい」と錯覚しがちですが、AIの場合は「詳細に書かれている=AIがノリノリで嘘を創作している」可能性があります!

個人・フリーランス向け!生成AIの嘘を防ぐ実践プロンプト術

AIが嘘をつきやすいポイントがわかったら、次はこちらからAIへの「指示の出し方(プロンプト)」を工夫して嘘を封じ込めましょう。

明日からすぐ実務で使える、ハルシネーション対策に特化したプロンプトのコツを3つ紹介します。

💡カッパパのワンポイントコラム:「正確に答えて!」という指示は逆効果?

よく、「事実に基づいて正確に答えてください」「絶対に嘘はつかないでください」という指示をプロンプトに入れる人がいますが、実はこれ、ほとんど効果がありません。

なぜなら、AI自身は何が「正確な事実」なのかを判断する仕組みを持っていないからです。むしろ「正確に答えて」とプレッシャーをかけることで、AIが「もっともらしい架空の文献(URLなど)」を捏造して、あたかも正確であるかのように装ってしまうリスクすらあります。 精神論ではなく、以下で紹介するような「具体的な仕組み」でAIをコントロールすることが重要です。

対策① 「確証がない時は『わからない』と答えて」と明記する

原因の章でお伝えした通り、AIは「テストで空白を恐れて適当な答えを書く生徒」と同じです。

ならば、最初から「答えが分からない時は、無理に答えなくていいよ」という許可を与えてあげれば良いのです。プロンプトの末尾に、以下の一文を付け加えるだけで、デタラメな情報が返ってくる確率を劇的に下げることができます。

▼ コピペ用プロンプト

※注意事項:

確実な知識や情報源がない場合、あるいは少しでも不確実な場合は、無理に推測して回答せず「わかりません」または「十分な情報がありません」と正直に答えてください。

対策② 情報を出す「手順(Chain-of-Thought)」をステップバイステップで指示する

AIにいきなり最終的な結論を出させると、途中の論理が飛躍してしまい、おかしな幻覚(嘘)が混ざりやすくなります。

これを防ぐためには、「その答えに至った理由を、ステップごとに順序立てて説明して」と指示するのが効果的です。これを専門用語で「Chain-of-Thought(思考の連鎖)」と呼びます。

過程をテキストとして出力させることで、AI自身の内部での論理矛盾が減り、人間側も「あ、ここで間違った前提を置いているな」と嘘に気づきやすくなります。

▼ コピペ用プロンプト

以下のテーマについて解説してください。

その際、いきなり結論を書くのではなく、どのような論理や情報に基づいてその結論に至ったのか、思考プロセスを「ステップ1」「ステップ2」と段階を追って説明してください。

対策③ 質問を徹底的に「具体化」し、解釈の余地を与えない

「今日の天気は?」といった短くて曖昧な質問は、AIに勝手な推測を許してしまうため、ハルシネーションの温床になります。

AIに指示を出すときは、「5W1H(誰が、いつ、どこで、何を、なぜ、どのように)」を意識して、質問をこれ以上ないほど具体化しましょう。AIに勝手な解釈の余地を与えないことが最大の防御になります。

❌ 悪いプロンプト例(曖昧) 「インボイス制度について教えて」 (※AIが勝手に「大企業向けの話」や「古い制度開始前の情報」を捏造する可能性がある)

⭕ 良いプロンプト例(具体的) 「2026年3月現在における、日本のインボイス制度について教えてください。ターゲットは『年間売上1000万円以下の免税事業者であるフリーランスのWebライター』です。彼らが今年取るべき対応策を3つ提示してください。」

このように、「いつ時点の情報か」「誰に向けた情報か」「何をいくつ出してほしいのか」をガチガチに指定することで、AIの無駄な創作(嘘)を未然に防ぐことができます。

AIに騙されないための「最強の運用テクニック」

プロンプトの工夫に加えて、AIを使う際の「運用ルール」を徹底することで、ハルシネーションのリスクはさらに激減します。

企業が導入するような難しいシステム(RAGなど)を使わなくても、個人・フリーランスが明日からすぐできる最強のテクニックを3つ紹介します。

信頼できるPDFやURLを読み込ませる(オープンブック法)

AIに記憶の中から答えを探させるのではなく、「最初から正解の資料を渡して、それだけを読んで答えさせる」という方法です。これが最も確実で効果的なハルシネーション対策になります。

やり方は非常にシンプルです。

- 政府の公式資料(PDF)や、信頼できる企業のWebサイトURLを用意する

- プロンプトに添付して「必ずこの資料の内容だけに基づいて回答して」と指示する

AIの知識ではなく、あなたの渡した資料をベースに答えを作るため、事実誤認が大幅に減ります。テストに例えるなら、教科書を見ながら回答して良い「オープンブック形式」にするイメージですね。医学領域の調査でも、この手法を使うことで事実の正確性が劇的に向上したという報告があります。

提示された「出典・URL」は絶対に自分でクリックして確認する

前述したように、AIは「いかにも実在しそうな架空のURLや論文」を息をするように捏造します。

AIが提示した出典を見て、「ちゃんとリンクが貼ってあるから安心だ」と鵜呑みにするのは最も危険な行為です。これを「誤信頼」と呼びます。

AIからURLや出典元が提示されたら、必ず自分の手でそのリンクをクリックし、本当にそのページが存在するのか、そして本当にその内容が書かれているのかを目視で確認してください。「AIの仕事の最終チェックは人間がやる」という意識が不可欠です。

ClaudeやGeminiなど「複数のAI」でセカンドオピニオンを取る

病気になった時に複数の医者に診てもらう(セカンドオピニオン)のと同じように、AIの回答も一つに依存せず、複数のAIでクロスチェックする習慣をつけましょう。

現在の生成AIは、モデルごとにそれぞれ違った強みを持っています。

- Claude(クロード): 非常に長文の資料を読み込むのが得意。また「誠実なAI」を目指して設計されており、分からない時は無理に嘘をつかず「分かりません」と答える傾向が強い。

- Gemini(ジェミニ): Google検索と深く連動(グラウンディング)しており、最新のニュースや時事問題に関して検索結果を踏まえた回答をするのが得意。

たとえば、「ChatGPTで作った文章の事実確認を、Claudeにやってもらう」といった具合に使い分けることで、ひとつのAIの思い込み(ハルシネーション)を別のAIが指摘してくれるようになります。

個人的な最強の使い分けは、「ChatGPTやGeminiでアイデア出しやリサーチをして、出てきた結果をClaudeに投げて『この中に論理の矛盾や嘘がないか厳しくチェックして』と指示する」ことです。 複数のAIを組み合わせることで、それぞれの弱点を補い合い、驚くほど精度の高いアウトプットが出せるようになりますよ!

まとめ:AIは「有能だけどちょっと嘘つきなアシスタント」として使いこなそう

いかがでしたでしょうか。今回は、ChatGPTをはじめとする生成AIの「ハルシネーション(嘘)」の原因と、その具体的な対策について解説しました。

最後にもう一度、重要なポイントを振り返っておきましょう。

- AIが嘘をつく理由: 「事実」ではなく「次に続く確率が高い言葉」を繋ぎ合わせているだけだから。

- 要注意なジャンル: 具体的な数字・統計、固有名詞、架空のURL、医療・法律などは絶対に鵜呑みにしない。

- 最強の対策: 信頼できるPDFやURLを直接読み込ませ、複数のAIでセカンドオピニオンを取る。

生成AIは、私たちの業務を圧倒的に効率化してくれる魔法のようなツールです。しかし、中身は「ものすごく仕事が早いけれど、たまに知ったかぶりをして嘘をつく新入社員(アシスタント)」のようなもの。

AIの特性と弱点をしっかり理解し、最終的なファクトチェックの手綱は私たち人間がしっかり握っておくこと。それこそが、AI時代を生き抜くフリーランスにとって最も重要なスキルです。

今回紹介したプロンプトや運用テクニックを取り入れて、安全かつ快適にAIを活用していきましょう!